末日逃亡(僵尸射击

240.4MB · 2026-04-01

最近在几个数据中台项目里,频繁用SeaTunnel做MongoDB到Doris的数据同步。说实话,这活儿看着简单,真上手了才发现坑不少。尤其是生产环境,数据量大、结构复杂,稍不注意就掉坑里。

这篇文章不打算重复那些基础配置步骤------网上已经有很多了。我想聚焦在实际生产环境中,那些最容易让人栽跟头的地方。特别是当你面对的是TB级别的MongoDB集合,需要稳定同步到Doris做实时分析时,下面这五个坑点,几乎每个都会遇到。我会结合具体的报错日志、排查思路,以及我们团队摸索出来的解决方案,帮你把这些坑一个个填平。

MongoDB的BSON类型系统和Doris的SQL类型系统,表面上看起来能自动映射,实际上藏着不少"惊喜"。最典型的就是Decimal128和ObjectId的处理。

MongoDB里用Decimal128存储高精度数值,比如金融交易的金额。SeaTunnel默认会把它映射成Doris的DECIMAL类型,但这里有个关键限制:Doris的DECIMAL最大支持38位精度,而Decimal128是34位小数位。如果你在SeaTunnel的schema里没明确指定精度,很可能遇到这样的错误:

java.lang.ArithmeticException: Non-terminating decimal expansion; no exact representable decimal result解决方案是在schema里显式声明精度。别用自动推断,手动控制:

source { MongoDB { uri = "mongodb://user:password@host:27017" database = "finance" collection = "transactions" schema = { fields { _id = string amount = "decimal(38, 18)" # 明确指定38位总精度,18位小数位 currency = string timestamp = timestamp } } }}注意:如果你的数据里Decimal128的小数位超过18位,需要根据实际情况调整。我们有个电商项目,优惠券计算精度要求高,就用了decimal(38, 24)。

MongoDB的_id字段默认是ObjectId类型,SeaTunnel会把它转成字符串。这看起来没问题,直到你发现Doris表里的主键冲突------因为ObjectId转字符串后,Doris的UNIQUE KEY检查可能会出问题。

更麻烦的是嵌套文档。MongoDB里很常见的结构:

{ "_id": ObjectId("507f1f77bcf86cd799439011"), "user": { "name": "张三", "address": { "city": "北京", "district": "朝阳区" } }}SeaTunnel默认会把整个user对象转成一个JSON字符串存到Doris的一个VARCHAR字段里。如果你想在Doris里直接查询user.address.city,就得用JSON函数解析,性能很差。

我们的做法是在SeaTunnel里用transform插件提前展开:

transform { # 展开嵌套字段 sql { query = """ SELECT _id, user.name as user_name, user.address.city as city, user.address.district as district FROM mongodb_source """ }}sink { Doris { fenodes = "fe1:8030,fe2:8030" username = "admin" password = "***" database = "analytics" table = "user_flat" # 现在表结构是平的,查询效率高 }}如果嵌套层级太深或者不确定,也可以考虑在Doris里用MAP类型,但要注意2.0以上版本才支持。

测试环境几十条数据,怎么跑都行。生产环境一上,连接超时、游标超时、内存溢出全来了。

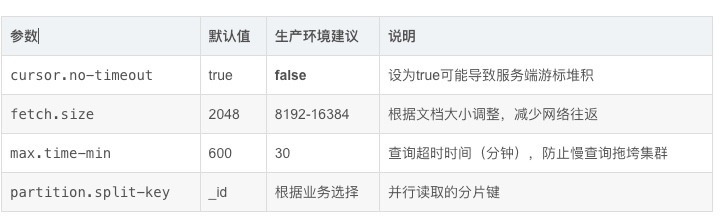

SeaTunnel的MongoDB源插件有几个关键参数容易被忽略:

我们踩过的一个大坑:cursor.no-timeout=true配合大数据量查询,MongoDB服务端积累了上百个游标,每个都占用内存,差点把集群搞挂。后来改成:

source { MongoDB { uri = "mongodb://user:password@host1:27017,host2:27017/?replicaSet=rs0&readPreference=secondaryPreferred" database = "logs" collection = "access_logs" cursor.no-timeout = false fetch.size = 16384 max.time-min = 30 partition.split-key = "_id" partition.split-size = 1048576 # 1MB一个分片 # 只同步最近7天的数据,避免全表扫描 match.query = "{timestamp: {$gte: ISODate('2024-01-01T00:00:00Z')}}" }}Doris Sink这边,核心是Stream Load的批处理参数。默认配置对小数据量友好,但生产环境需要调整:

sink { Doris { fenodes = "fe1:8030,fe2:8030,fe3:8030" username = "sync_user" password = "***" database = "dw" table = "fact_table" sink.label-prefix = "seatunnel_sync" sink.enable-2pc = true # 开启两阶段提交,保证Exactly-Once sink.buffer-size = 524288 # 512KB,默认256KB太小 sink.buffer-count = 5 # 缓冲区数量 doris.batch.size = 5000 # 每批5000行,默认1024 # 关键:Stream Load的高级参数 doris.config = { format = "json" read_json_by_line = "true" strip_outer_array = "true" num_as_string = "true" # 数字也转字符串,避免类型问题 # 连接和超时控制 connect_timeout = "10" socket_timeout = "30" # 部分更新模式(如果表是Unique模型) partial_columns = "true" merge_type = "MERGE" } }}这里有个细节:sink.label-prefix在每个任务中必须唯一,否则Doris会拒绝重复的导入标签。我们用的是"seatunnel_${job_id}_${timestamp}"的模式。

同步任务跑得慢,通常不是某一个原因,而是多个环节叠加的结果。

首先要知道瓶颈在哪。我们常用的监控组合:

曾经有个案例,同步速度卡在1000条/秒上不去。排查后发现:

SeaTunnel支持基于partition.split-key的并行读取。但默认用_id分片不一定是最优的。

如果数据有天然的时间维度,比如日志表,用时间字段分片效果更好:

source { MongoDB { # 假设每条记录都有event_time字段 partition.split-key = "event_time" partition.split-size = 3600000 # 按1小时分片 # 配合查询条件,避免全表扫描 match.query = """ { event_time: { $gte: ISODate("2024-01-01T00:00:00Z"), $lt: ISODate("2024-01-02T00:00:00Z") } } """ }}如果数据分布不均匀,可以先用聚合查询分析键值分布:

// 在MongoShell里执行db.collection.aggregate([ { $bucketAuto: { groupBy: "$shard_key", buckets: 10 } }])SeaTunnel基于JVM,大数据量时GC问题很常见。我们的生产环境JVM参数:

# seatunnel_env.sh 或启动脚本export JAVA_OPTS="-Xmx8g -Xms8g \-XX:+UseG1GC \-XX:MaxGCPauseMillis=200 \-XX:InitiatingHeapOccupancyPercent=35 \-XX:ParallelGCThreads=4 \-XX:ConcGCThreads=2 \-XX:+AlwaysPreTouch \-XX:+UseStringDeduplication \-XX:+PrintGCDetails \-XX:+PrintGCDateStamps \-Xloggc:/var/log/seatunnel/gc.log"关键点是-XX:+AlwaysPreTouch,启动时预分配内存,避免运行时抖动。

数据同步不能丢数据,也不能重复。SeaTunnel支持Exactly-Once语义,但需要正确配置。

Doris Sink的sink.enable-2pc = true开启两阶段提交,理论上能保证Exactly-Once。但我们遇到过一个诡异问题:任务失败重试后,数据重复了。

原因是标签(Label)重复使用。SeaTunnel在失败重试时,如果用了相同的label-prefix,Doris会认为这是同一个导入任务,可能跳过某些数据。

解决方案:在label中加入时间戳和尝试次数:

sink { Doris { sink.label-prefix = "sync_${table_name}_${now()}_${attempt_num}" sink.enable-2pc = true sink.max-retries = 3 sink.check-interval = 5000 # 5秒检查一次 }}MongoDB是schema-less的,同一个字段可能这行是字符串,下一行是数字。Doris有严格schema,类型不匹配就报错。

SeaTunnel的needs_unsupported_type_casting参数可以帮点忙:

sink { Doris { # 尝试自动转换不兼容的类型,比如Decimal到Double needs_unsupported_type_casting = true # 但更推荐在transform层处理 }}transform { # 在写入前统一类型 sql { query = """ SELECT CAST(amount AS DOUBLE) as amount_double, COALESCE(name, '') as name_safe, # 处理null REGEXP_REPLACE(description, '[\\x00-\\x1F]', '') as description_clean FROM source_table """ }}SeaTunnel支持Checkpoint,但需要正确配置存储后端。我们用的是HDFS:

env { execution.parallelism = 8 job.mode = "BATCH" # Checkpoint配置 checkpoint.interval = 60000 # 1分钟一次 checkpoint.timeout = 600000 # 10分钟超时 checkpoint.max-concurrent-checkpoints = 1 state.backend = "hdfs" state.checkpoints.dir = "hdfs://namenode:8020/seatunnel/checkpoints" state.savepoints.dir = "hdfs://namenode:8020/seatunnel/savepoints" # 任务失败后从最近checkpoint恢复 execution.savepoint-restore.enabled = true}有个细节:Checkpoint频率太高会影响性能,太低则恢复时可能重复处理太多数据。我们一般按数据量来,比如每处理100万行做一次Checkpoint。

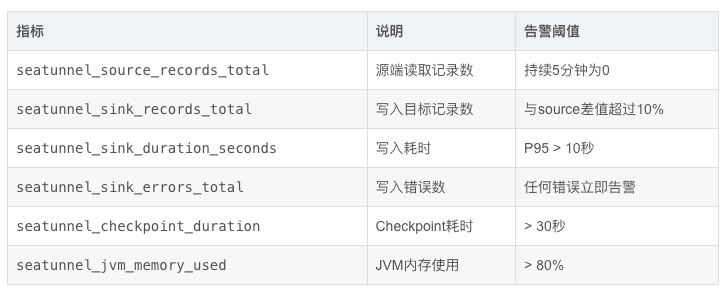

最后这个不是技术坑,但比技术坑更致命------缺乏监控,等用户反馈数据不对了才发现同步任务早就挂了。

我们会在Prometheus里监控这些指标(通过SeaTunnel的JMX暴露):

Grafana面板配置示例:

-- 同步延迟监控SELECT time_bucket('1m', timestamp) as time, source_max_timestamp - sink_max_timestamp as lag_secondsFROM ( -- 源端最大时间戳 SELECT MAX(event_time) as source_max_timestamp FROM mongodb_source_table WHERE event_time > now() - interval '1 hour') source,( -- 目标端最大时间戳 SELECT MAX(event_time) as sink_max_timestamp FROM doris_target_table WHERE event_time > now() - interval '1 hour') sinkGROUP BY 1ORDER BY 1 DESC有些常见错误可以自动修复。比如Doris表空间不足:

#!/bin/bash# auto_extend_doris.shERROR_LOG=$1TABLE_NAME=$(grep -o "table [a-zA-Z0-9_]*" "$ERROR_LOG" * head -1 * cut -d' ' -f2)if [[ -n "$TABLE_NAME" ]]; then # 检查表分区使用率 USAGE=$(mysql -h doris-fe -P 9030 -u admin -p'***' -e \ "SHOW PARTITIONS FROM $TABLE_NAME WHERE UsedPercent > 90;" * wc -l) if [[ $USAGE -gt 0 ]]; then # 自动添加分区 mysql -h doris-fe -P 9030 -u admin -p'***' <同步完成后自动校验:

# validate_sync.pyimport pymongoimport pymysqlfrom datetime import datetime, timedeltadef validate_counts(): # MongoDB计数 mongo_client = pymongo.MongoClient("mongodb://host:27017") mongo_count = mongo_client.db.collection.count_documents({ "update_time": {"$gte": datetime.utcnow() - timedelta(hours=1)} }) # Doris计数 doris_conn = pymysql.connect(host="doris-fe", port=9030, user="admin", password="***", database="dw") with doris_conn.cursor() as cursor: cursor.execute(""" SELECT COUNT(*) FROM target_table WHERE update_time >= DATE_SUB(NOW(), INTERVAL 1 HOUR) """) doris_count = cursor.fetchone()[0] # 允许1%的误差(考虑删除、更新等情况) diff_ratio = abs(mongo_count - doris_count) / max(mongo_count, 1) if diff_ratio > 0.01: send_alert(f"数据不一致: MongoDB={mongo_count}, Doris={doris_count}, 差异={diff_ratio:.2%}") return False return True这套监控体系搭起来后,我们团队再也没被半夜的报警叫醒过------不是没问题了,而是问题在影响业务前就被自动处理了。

这些坑点都是实打实用时间和精力填出来的。数据同步这件事,配置正确只是开始,真正的挑战在于生产环境的稳定运行。下次你遇到SeaTunnel同步问题,可以先对照这五个方面排查,大概率能找到方向。每个环境都有自己的特殊性,但这些核心问题的解决思路是相通的。

原文链接:https://blog.csdn.net/weixin_29092031/article/details/158077169

",