无限极服务

146.43MB · 2025-10-24

WebAIGC(Web-based AI Generated Content)已经从一道技术风景,变成了互联网的主旋律。无论是自动生成的图文、代码,还是“AI主持新闻联播”,在这个信息的浪潮中,内容的数量与复杂度几何级增长。

然而,当AI的创造力超越人类的控制时,未成年人的网络安全与心理保护就成了一项需要极高技术含量与社会责任感的系统工程。

于是,**内容分级过滤机制(Content Filtering & Classification System)**便登场了。它既是一面盾牌️,也是一个智慧的“家长模式”。

要想在技术层面上保护未成年人,我们必须先理解WebAIGC的底层逻辑。AI并不是“理解”文字,而是在“预测”下一个最可能出现的符号。

所以,当模型生成“某种敏感言论”时,它并非“有意为之”,而是统计学的产物。这种“原罪”让我们不能简单用黑白名单过滤,而应该用层级理解模型分级系统。

| 层级 | 内容类型 | 风险程度 | 示例 |

|---|---|---|---|

| L0 | 普通内容(教学、科普) | 安全 | “如何学习JavaScript语法” |

| L1 | 轻度敏感(情绪冲突、竞争) | ️需判断语义环境 | “游戏胜负的心理变化” |

| L2 | 中度敏感(暴力、虚构场景) | 需内容隐藏或弱化 | “剑与魔法的极端冲突” |

| L3 | 高危(违法、色情、恐怖) | 绝对过滤 | 禁止生成 |

一个合理的AIGC内容过滤系统,基本可以分为下面三层:

语义识别层(Semantic Parsing Layer)

风险评估层(Risk Assessment Layer)

safe、review、block。策略执行层(Policy Enforcement Layer)

下面我们用JavaScript来模拟一个极简内容分级模型。

它不是机器学习模型,而是算法逻辑演示,用于帮助理解系统结构:

// 模拟AIGC内容分级过滤系统

const riskDictionary = {

violence: ["打斗", "血腥", "枪", "杀"],

sexual: ["裸", "性", "情色", "激情"],

terror: ["恐怖", "怪物", "鬼"],

};

function assessContent(content) {

let score = 0;

let category = "L0-安全";

for (const [key, words] of Object.entries(riskDictionary)) {

for (let w of words) {

if (content.includes(w)) {

score++;

if (score === 1) category = "L1-轻微风险";

if (score === 2) category = "L2-中度风险";

if (score >= 3) category = "L3-高危";

}

}

}

return { content, riskLevel: category };

}

// 测试样例

const texts = [

"今天学习JavaScript基础",

"电影里打斗场面非常精彩",

"这是一场激情与恐怖交织的盛宴!",

];

texts.forEach(t => console.log(assessContent(t)));

运行结果(示意) :

{ content: '今天学习JavaScript基础', riskLevel: 'L0-安全' }

{ content: '电影里打斗场面非常精彩', riskLevel: 'L1-轻微风险' }

{ content: '这是一场激情与恐怖交织的盛宴!', riskLevel: 'L3-高危' }

当然,真实系统不仅仅是匹配关键词,而是结合同义词识别、上下文权重、语言模型判别与概率阈值控制。

如今的AI过滤技术,正逐渐从**基于规则(Rule-based)向基于学习(Learning-based)**转变。

| 技术类型 | 优点 | 缺点 |

|---|---|---|

| Rule-based | 易部署,可解释 | 不灵活,无法应对语义变体 |

| ML-based | 泛化强,可自动学习 | 训练代价高,存在误判风险 |

| Hybrid | 综合优势,运行稳定 | 系统复杂度高 |

未来的AI内容管理系统,可能不只是“发现问题”,更会“引导表达”。

比如,在检测到高风险生成趋势时,自动提示模型进入“儿童模式”,主动调整生成方向:

AI不再是“管控者”,而是“守护者”。

想象你在管理一座“AI花园”:

园丁不能简单地“砍掉”不合规的植物,而要修剪、疏导、指导其健康生长。

最终,我们要构建的是一个“不会让孩子误入禁区,却又能自由探索的花园”。

保护未成年人不只是技术命题,更是社会伦理与教育命题。

AI系统的每一个过滤规则背后,都是我们对人类价值的再确认:

“什么是适合成长,什么是值得启发。”

当算法带上人性的温度,科技才能真正成为保护者,而非冷漠的裁决者。

2025-10-24

2025-10-24

网易《逆水寒》手游与宇树科技达成合作,虚拟世界将成机器人技术试验田

2025-10-24

2025-10-24

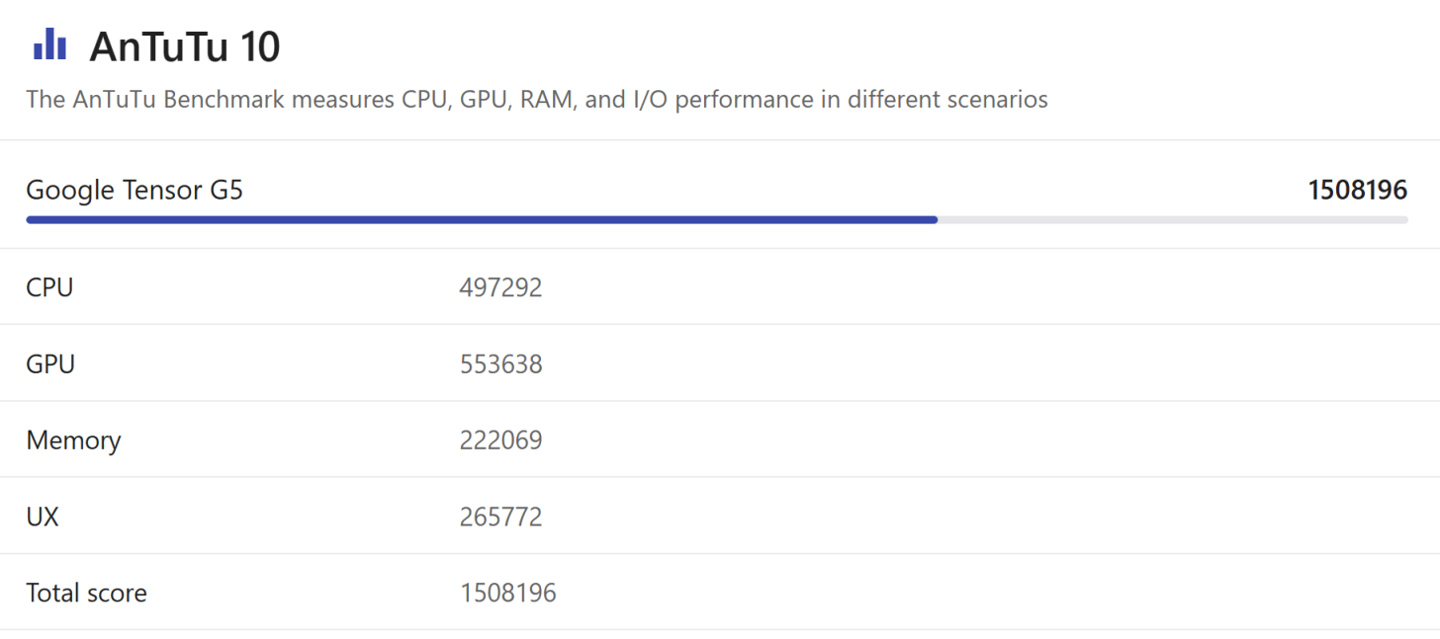

谷歌间接承认 Tensor G5 芯片存在 GPU 问题,将推送更新优化 Pixel 10 系列手机