反物质维度

69.50M · 2026-03-22

在本地开发时,日志往往被误认为只是简单的控制台输出。然而,当项目进入独立部署的生产环境,面对突发的故障和海量日志时,一套成熟的日志体系就是系统的“眼睛”和“指南针”。

能否设计出兼顾性能与排障效率的日志系统,是衡量一个开发者工程化成熟度的重要标志。本篇文章将带你从零构建一套生产级的全链路追踪体系,助你掌握微服务治理的核心实战。

为了方便读者参考,本项目基于最新的 Spring Cloud Alibaba 生态构建,核心版本如下:

本项目是一个开箱即用的微服务脚手架,主要模块职责如下:

cloud-gateway: API 网关,负责流量入口、鉴权与 TraceId 生成。cloud-common: 公共模块,包含 日志拦截器、MDC 配置与 Feign 透传。cloud-user / cloud-producer / cloud-consumer: 具体的业务微服务。源码参考:本项目已开源,欢迎 Star 支持! GitHub 地址:spring-cloud-alibaba-base-demo

在正式撸代码之前,我们需要先思考一个落地问题:既然微服务架构强调统一管理,我们能不能只写一个 logback-spring.xml 扔进公共模块(Common),让网关和业务服务都引用它?

答案是:不建议,甚至由于架构差异,这会成为系统埋下的“性能地雷”。

在本方案中,我们将分别在 cloud-gateway 和 cloud-common 中配置两套独立的 logback-spring.xml。这种看似“啰嗦”的做法,源于我在实战中对分布式系统吞吐量与排障成本的权衡:

DEBUG 监控。链路追踪的核心在于“唯一标识”。我们在网关生成 TraceId,并由其开启整条链路。

cloud-gateway 模块类:com.xf.gateway.filter.AuthFilter

代码为简化版本只展示traceId生成逻辑,其他代码省略。

@Slf4j

@Component

public class AuthFilter implements GlobalFilter, Ordered {

private static final String TRACE_ID_HEADER = "traceId";

@Override

public Mono<Void> filter(ServerWebExchange exchange, GatewayFilterChain chain) {

long startTime = System.currentTimeMillis();

// 1. 生成全局唯一 TraceId (UUID 去除横杠)

String traceId = UUID.randomUUID().toString().replace("-", "");

// 2. 将 TraceId 放入响应头,方便前端开发者在浏览器控制台直接看到 ID

exchange.getResponse().getHeaders().set(TRACE_ID_HEADER, traceId);

// 3. 将 TraceId 透传给下游微服务

ServerHttpRequestDecorator decorator = new ServerHttpRequestDecorator(exchange.getRequest()) {

@Override

public HttpHeaders getHeaders() {

HttpHeaders headers = new HttpHeaders();

headers.putAll(super.getHeaders());

headers.set(TRACE_ID_HEADER, traceId);

return headers;

}

};

return chain.filter(exchange.mutate().request(decorator).build())

.doFinally(signalType -> {

// 网关访问日志:记录 IP、路径、状态码、耗时和最重要的 TraceId

log.info("[Access] IP: {}, Path: {}, Status: {}, Time: {}ms, TraceId: {}",

exchange.getRequest().getRemoteAddress().getAddress().getHostAddress(),

exchange.getRequest().getURI().getPath(),

exchange.getResponse().getStatusCode(),

System.currentTimeMillis() - startTime,

traceId);

// 清理当前线程 MDC

MDC.remove("traceId");

});

}

}

在讲后续代码前,必须先了解一个核心概念:MDC (Mapped Diagnostic Context)。

当请求流转到业务服务(如 User 服务)时,我们需要接力这个 TraceId。

cloud-common 模块 (业务服务通用)接收并存入 MDC ,位置:com.xf.cloudcommon.filter.RequestHeaderFilter

@Configuration

@Slf4j

public class RequestHeaderFilter implements Filter {

@Override

public void doFilter(ServletRequest request, ServletResponse response, FilterChain chain) throws IOException, ServletException {

HttpServletRequest req = (HttpServletRequest) request;

// 从 Header 中取出网关生成的 traceId

String traceId = req.getHeader("traceId");

if (StringUtils.hasText(traceId)) {

// 核心:存入 MDC

MDC.put("traceId", traceId);

}

try {

chain.doFilter(request, response);

} finally {

// 必须清理!防止线程复用(线程池)导致下一次请求复用旧的 traceId

MDC.remove("traceId");

}

}

}

如果你在业务代码中调用了其他微服务,TraceId 需要继续传递。

类:com.xf.cloudcommon.config.FeignConfig

@Configuration

public class FeignConfig implements RequestInterceptor {

@Override

public void apply(RequestTemplate template) {

// 从当前线程的 MDC 中取出 traceId,塞入 Feign 的请求头

String traceId = MDC.get("traceId");

if (traceId != null) {

template.header("traceId", traceId);

}

}

}

有了 YAML 的级别控制后,我们开始编写核心的 logback-spring.xml。由于架构差异,我们需要准备两份。

创建一个 logback-spring.xml 文件,并放在 cloud-common 模块的 src/main/resources 目录下。

这份配置将通过 Maven 依赖传递给所有业务模块。它的核心任务是:详尽记录业务行为与 SQL。

<?xml version="1.0" encoding="UTF-8"?>

<configuration scan="true" scanPeriod="60 seconds">

<springProperty scope="context" name="APP_NAME" source="spring.application.name" defaultValue="service"/>

<springProperty scope="context" name="LOG_PATH" source="logging.file.path" defaultValue="./logs/${APP_NAME}"/>

<!-- 格式化:包含核心的 [traceId:%X{traceId}] -->

<property name="LOG_PATTERN" value="%d{yyyy-MM-dd HH:mm:ss.SSS} [%thread] %-5level [traceId:%X{traceId}] %logger{50} - %msg%n" />

<!-- 控制台输出 -->

<appender name="STDOUT" class="ch.qos.logback.core.ConsoleAppender">

<encoder><pattern>${LOG_PATTERN}</pattern></encoder>

</appender>

<!-- 滚动文件输出 -->

<appender name="INFO_FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<file>${LOG_PATH}/info.log</file>

<rollingPolicy class="ch.qos.logback.core.rolling.SizeAndTimeBasedRollingPolicy">

<fileNamePattern>${LOG_PATH}/history/info.%d{yyyy-MM-dd}.%i.log.gz</fileNamePattern>

<maxFileSize>500MB</maxFileSize>

<maxHistory>60</maxHistory>

</rollingPolicy>

<encoder><pattern>${LOG_PATTERN}</pattern></encoder>

</appender>

<!-- SQL 专项审计:只拦截并记录 DEBUG 级别的 SQL 日志 -->

<appender name="SQL_FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<file>${LOG_PATH}/sql.log</file>

<filter class="ch.qos.logback.classic.filter.LevelFilter">

<level>DEBUG</level>

<onMatch>ACCEPT</onMatch>

<onMismatch>DENY</onMismatch>

</filter>

<rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy">

<fileNamePattern>${LOG_PATH}/history/sql.%d{yyyy-MM-dd}.log</fileNamePattern>

<maxHistory>7</maxHistory>

</rollingPolicy>

<encoder><pattern>${LOG_PATTERN}</pattern></encoder>

</appender>

<!-- 异步输出器:大幅提升并发写入效率 -->

<appender name="ASYNC_INFO" class="ch.qos.logback.classic.AsyncAppender">

<queueSize>1024</queueSize>

<appender-ref ref="INFO_FILE" />

</appender>

<logger name="com.xf" level="DEBUG" additivity="true">

<appender-ref ref="SQL_FILE" />

</logger>

<root level="INFO">

<appender-ref ref="STDOUT" />

<appender-ref ref="ASYNC_INFO" />

</root>

</configuration>

创建一个 logback-spring.xml 文件,并放在 cloud-gateway 模块的 src/main/resources 目录下。

网关作为全量流量入口,这里的日志重心在于:降噪与极高性能。同时,由于网关异常往往意味着系统性的崩溃(如连接池满、熔断),因此独立存储错误日志(error.log) 对于故障预警至关重要。

<?xml version="1.0" encoding="UTF-8"?>

<configuration scan="true" scanPeriod="60 seconds">

<springProperty scope="context" name="APP_NAME" source="spring.application.name" defaultValue="gateway"/>

<springProperty scope="context" name="LOG_PATH" source="logging.file.path" defaultValue="logs/${APP_NAME}"/>

<property name="LOG_PATTERN" value="%d{yyyy-MM-dd HH:mm:ss.SSS} [%thread] %-5level [traceId:%X{traceId}] %logger{50} - %msg%n" />

<!-- 1. 控制台输出 -->

<appender name="STDOUT" class="ch.qos.logback.core.ConsoleAppender">

<encoder><pattern>${LOG_PATTERN}</pattern></encoder>

</appender>

<!-- 2. 全量日志 (INFO 及以上) -->

<appender name="INFO_FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<file>${LOG_PATH}/info.log</file>

<rollingPolicy class="ch.qos.logback.core.rolling.SizeAndTimeBasedRollingPolicy">

<fileNamePattern>${LOG_PATH}/history/info.%d{yyyy-MM-dd}.%i.log.gz</fileNamePattern>

<maxFileSize>500MB</maxFileSize>

<maxHistory>15</maxHistory>

</rollingPolicy>

<encoder><pattern>${LOG_PATTERN}</pattern></encoder>

</appender>

<!-- 3. 独立错误日志 (ERROR 专项):方便统一采集进行钉钉/邮件报警 -->

<appender name="ERROR_FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<file>${LOG_PATH}/error.log</file>

<!-- 临界值过滤器:只记录 ERROR 级别及以上的日志 -->

<filter class="ch.qos.logback.classic.filter.ThresholdFilter">

<level>ERROR</level>

</filter>

<rollingPolicy class="ch.qos.logback.core.rolling.SizeAndTimeBasedRollingPolicy">

<fileNamePattern>${LOG_PATH}/history/error.%d{yyyy-MM-dd}.%i.log.gz</fileNamePattern>

<maxFileSize>1GB</maxFileSize>

<maxHistory>30</maxHistory>

</rollingPolicy>

<encoder><pattern>${LOG_PATTERN}</pattern></encoder>

</appender>

<!-- 异步输出:网关必配 -->

<appender name="ASYNC_INFO" class="ch.qos.logback.classic.AsyncAppender">

<queueSize>2048</queueSize>

<discardingThreshold>0</discardingThreshold>

<appender-ref ref="INFO_FILE"/>

</appender>

<!-- 屏蔽 Netty 等底层噪音 -->

<logger name="reactor.netty" level="WARN" />

<logger name="org.springframework.cloud.gateway" level="INFO" />

<logger name="com.alibaba.nacos" level="WARN" />

<root level="INFO">

<appender-ref ref="STDOUT" />

<appender-ref ref="ASYNC_INFO" />

<appender-ref ref="ERROR_FILE" />

</root>

</configuration>

${spring.application.name}: 利用 Spring 对 Logback 的增强,自动识别当前微服务名,实现全自动的日志分级存储。%X{traceId}: 全篇最关键点。%X 是 Logback 专门为 MDC 预留的接口。它会自动从当前线程的诊断上下文中抓取键为 traceId 的值。AsyncAppender: 它是异步任务队列。在高并发请求下,业务线程只负责把日志“扔进队列”就立即返回,避免了昂贵的磁盘写入 IO 阻塞核心业务流程。LevelFilter vs ThresholdFilter:

LevelFilter 用于“精确匹配”(如:只要 DEBUG);ThresholdFilter 用于“临界值过滤”(如:ERROR 及以上)。在我们的方案中,SQL 审计使用了前者,确保 sql.log 不会被大量的 INFO 日志污染。在编写具体的 XML 日志策略前,我们需要在 application.yml(推荐通过 Nacos 统一管理)中定义日志的基础行为。

为了保证全链路日志的格式和存储路径统一,建议将以下配置作为公共配置(如 common-config.yaml)维护。

本项目中已提供在doc文件夹中

logging:

# 1. 强制指定 Logback 配置文件路径,确保加载我们自定义的 XML

config: classpath:logback-spring.xml

file:

# 2. 动态路径:所有微服务根据自己的 application.name 创建文件夹

# 生产环境通常挂载到统一宿主机目录,如 /data/servers/logs/

path: /data/servers/logs/${spring.application.name}

level:

root: info

# 3. 业务包级别,设为 debug 才能在开发环境查看到详细链路和 SQL

com.xf: debug

# 4. 屏蔽 Spring 框架过细的启动日志,保持日志整洁

org.springframework: warn

配置好公共配置后,我们在各个微服务的 bootstrap.yml 中直接引入即可:

spring:

config:

import: #指定加载配置的方式以及文件

- nacos:common-config.yaml

在真实的生产环境中,仅仅让日志打印出来是不够的,我们还要让它“跑得久、跑得稳”。

问题:【踩坑】多线程下的 MDC 丢失

MdcTaskDecorator代码位置:cloud-common 模块 -> com.xf.cloudcommon.config.MdcTaskDecorator

public class MdcTaskDecorator implements TaskDecorator {

@Override

public Runnable decorate(Runnable runnable) {

// 1. 抓取主线程的 MDC 上下文

Map<String, String> contextMap = MDC.getCopyOfContextMap();

return () -> {

try {

// 2. 搬运到子线程

if (contextMap != null) MDC.setContextMap(contextMap);

runnable.run();

} finally {

// 3. 必须清理,防止线程复用污染

MDC.clear();

}

};

}

}

代码位置:cloud-common 模块 -> com.xf.cloudcommon.config.ThreadPoolConfig

@Configuration

@EnableAsync

public class ThreadPoolConfig {

@Bean("taskExecutor")

public Executor taskExecutor() {

ThreadPoolTaskExecutor executor = new ThreadPoolTaskExecutor();

// ... 其他常规配置

// 核心:注入装饰器实现透传

executor.setTaskDecorator(new MdcTaskDecorator());

executor.initialize();

return executor;

}

}

性能优化:行号(%L)带来的开销

优雅停机:记录最后一条日志

<shutdownHook class="ch.qos.logback.core.hook.DefaultShutdownHook"/>

很多开发者疑惑:既然 Netty 线程数少,性能不是应该更差吗?其实不然。我们需要深刻理解两者在处理高并发时的本质差异:

| 维度 | 业务服务 (Spring MVC) | 网关 (Spring Cloud Gateway) | 优势分析 |

|---|---|---|---|

| 底层核心 | Tomcat / Jetty (基于 Servlet) | Netty (基于 WebFlux) | - |

| 线程模型 | 阻塞式:一请求一线程。 | 非阻塞式:事件驱动(Event Loop)。 | Netty 避免了成百上千个线程频繁调度的上下文切换开销。 |

| 线程配置 | 通常 200~500 个线程。 | 通常 = CPU 核心数 * 2。 | 极少数线程就能打满 CPU 性能,内存占用极低。 |

| 日志风险 | 慢日志仅导致单个线程不可用。 | 日志阻塞会直接拖垮核心 EventLoop 线程。 | 灾难性风险:一个 EventLoop 阻塞,数千个连接会同时卡死。 |

| 治理策略 | 侧重业务轨迹保留。 | 侧重降噪与非阻塞输出。 | 必须使用 AsyncAppender 保护系统的“金牌销售”(EventLoop)。 |

结论:在网关架构下,“少线程”意味着极致的并发处理能力,但它的容错率极低——绝对不能出现任何同步阻塞操作(如直接写磁盘日志)。

在 Logback 或 SLF4J 中,日志等级有着严格的包含关系:

TRACE < DEBUG < INFO < WARN < ERROR

关键点:

INFO,则 INFO、WARN、ERROR 的日志均会输出;DEBUG 和 TRACE 被丢弃。false,子 Logger 打印的内容会同时在 Root 预设的终端再次打印。容易被忽视的关键点 生产环境中,打印 SQL 是把双刃剑:

mybatis-plus.configuration.log-impl:它是底层数据库驱动级别的输出,会绕过 Spring 日志体系,导致记录无法带上 TraceId。logging.level.<package>: debug:通过 Logback 体系输出,不仅格式可控,还能享受 MDC 带来的 TraceId 追踪效果。在微服务实战中,有一个常被忽略的“潜规则”:框架噪音(如 Netty/Nacos)建议死扣在 XML 里,而业务日志建议动态配置在 Nacos 里。

| 类别 | 建议位置 | 建议级别 | 理由 (防御性编程思维) |

|---|---|---|---|

| 基础噪音 (Netty/Nacos) | logback-spring.xml | WARN | 静态防御:防止全局 DEBUG 动态生效导致网关磁盘瞬间爆满挂掉。 |

业务代码 (com.xf) | Nacos / YAML | INFO (动态切 DEBUG) | 动态追踪:线上查错最核心的抓手,需实现“即配即见”。 |

| Spring 核心路由 | Nacos / YAML | INFO | 按需开启:仅在怀疑路由配置出错时短时间开启,查完即关。 |

配置了精妙的日志策略,如果部署时没有做好“持久化挂载”,容器重启后所有日志都会化为乌有。

无论你是使用原始 Docker 命令还是 Jenkins 自动化流水线,核心只有一句话:将容器内的日志目录映射到宿主机。

Docker 直接启动:在命令行中增加 -v 参数。

docker run -d --name cloud-user

-v /data/servers/logs:/data/servers/logs

... 镜像名

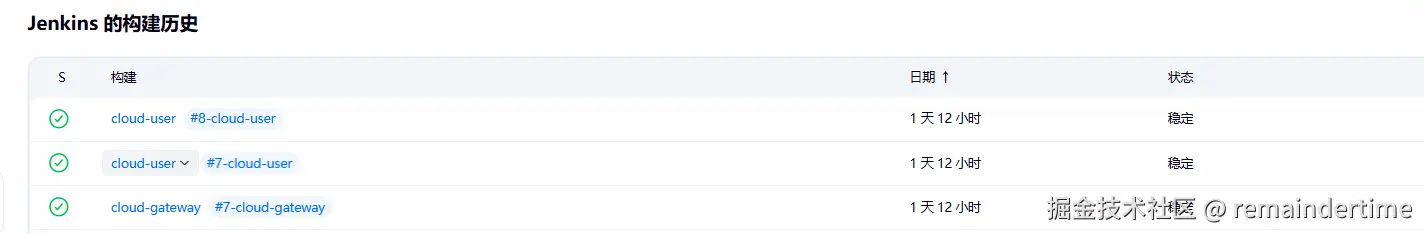

Jenkins 流水线集成: 如果你之前看过我写的 《Jenkins 自动化部署架构实战》,现在只需要在流水线脚本(或配置界面)的第四步:远程部署配置中,在构建位置附加以下挂载命令即可:

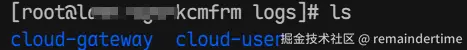

/data/servers/logs 下,不仅方便我们运维同学直接查阅,还为后续引入 ELK(Elasticsearch + Logstash + Kibana) 或 Filebeat 采集日志埋下了完美的伏笔。启动项目查看日志文件是否自动生成

配置完成后,一次完整的全链路追踪效果如下:

[Access] ... TraceId: a1b2c3d4[traceId:a1b2c3d4] [com.xf.user...] 查询用户信息成功[traceId:a1b2c3d4] [com.xf.order...] 创建订单整条链路如同一根长线,将散落在各个微服务的散珠(日志)完美串联。

分布式日志治理不仅仅是技术实现,更是一种工程化的管理思维。通过对网关与业务服务物理层面的日志分离、基于 MDC 的链路标识、Nacos 的统一分发、多线程上下文的守护,以及宿主机目录的持久化挂载,我们才能真正在大规模集群中实现“运筹帷幄之中,决策千里之外”。