老爹疯狂厨房

125.32M · 2026-03-31

在 AI 应用爆发的今天,我们经常需要同时使用多个大模型服务——有的平台优惠力度大,有的模型在某些任务上表现更好,还有的提供商网络访问更稳定。但为每一个服务单独配置 API、管理密钥、对接客户端,无疑增加了使用门槛和运维成本。

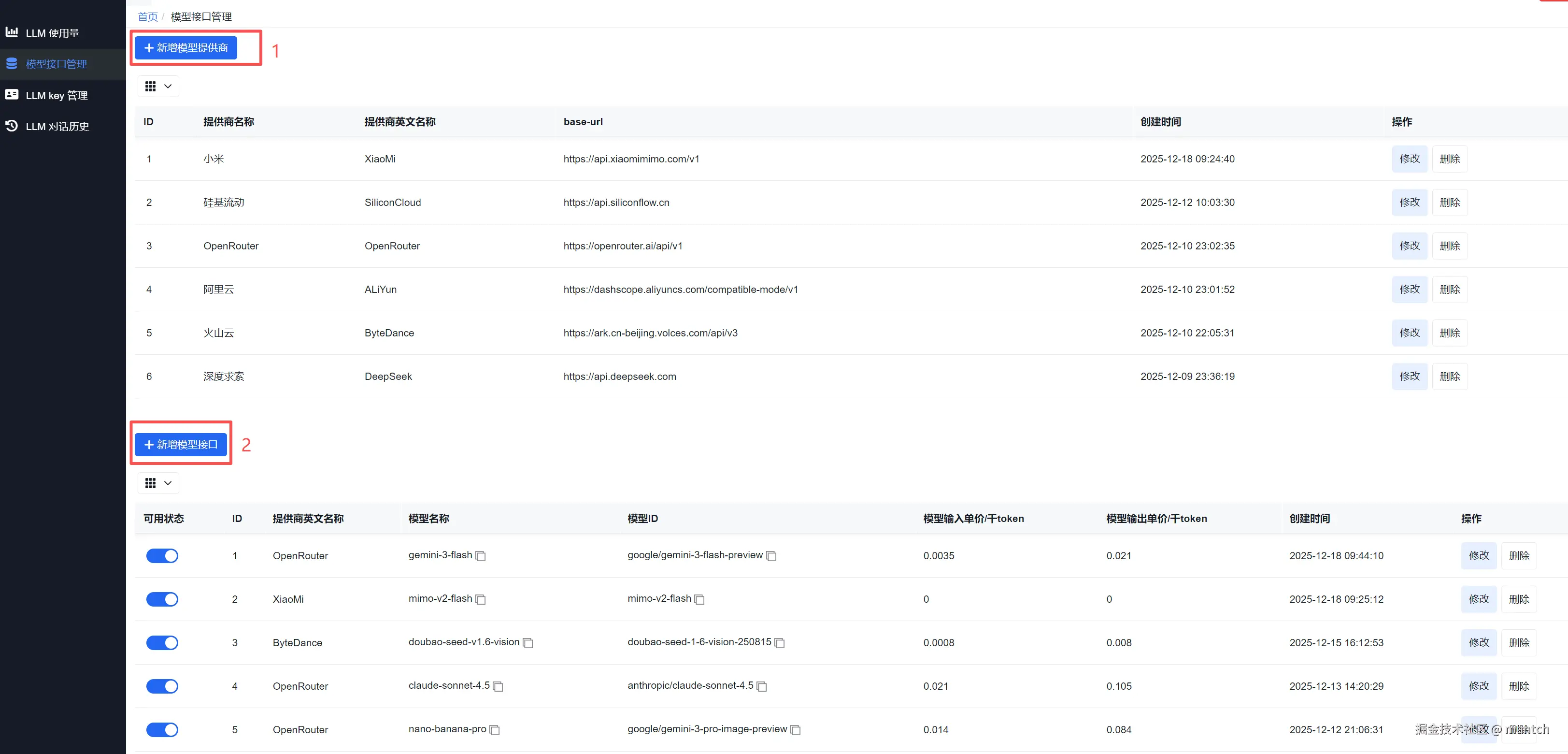

今天要介绍的开源项目 Personal LLM API,正是为了解决这一问题而生。它是一个专为个人用户设计的轻量级 LLM 接口聚合服务,让你能够通过一个统一的入口,灵活调度和管理来自不同提供商的 AI 模型。

Personal LLM API 基于 Python 和 FastAPI 构建,提供了与 OpenAI API 完全兼容的接口规范。与同类项目相比,它更加注重个人使用的简洁性和极致的交互体验,尤其在与高颜值客户端(如 Cherry Studio)搭配时,能实现丝滑的“打字机”流式输出效果。

GitHub 项目地址:github.com/NLP-LOVE/pe…

/v1/chat/completions 和 /chat/completions)response 接口转标准 chat 接口,便于客户端接入部署仅需几步:

pip install -r requirements.txtapp_config.yaml 配置文件(设置数据库、代理等)python3 main_personal_llm.py/chat/completions接口

该项目特别优化了与 Cherry Studio 客户端的兼容性。你只需在 Personal LLM API 后台配置好模型密钥,然后在 Cherry Studio 中添加一个自定义 OpenAI 兼容接口,即可享受:

项目提供了完整的管理功能,包括:

体验 Demo: llmdashboard.demo.dx3906.info/dashboard/l…

(账号:test,密码:12345678)

项目作者还计划加入更多实用功能:

无论你是 AI 爱好者、开发者,还是经常需要切换使用不同大模型的个人用户,Personal LLM API 都能为你提供一个干净、统一、可控的 AI 入口。它用简洁的技术栈解决了多模型管理的痛点,让每个人都能轻松拥有属于自己的智能助手调度中心。

项目地址:github.com/NLP-LOVE/Pe…

如果你正在寻找一个轻量、易扩展、且对个人用户友好的 LLM 接口聚合方案,不妨试试这个项目,或许它能成为你 AI 工作流中那个“恰到好处”的枢纽。

微信公众号: