泡泡射手苹果版

134.2M · 2025-09-25

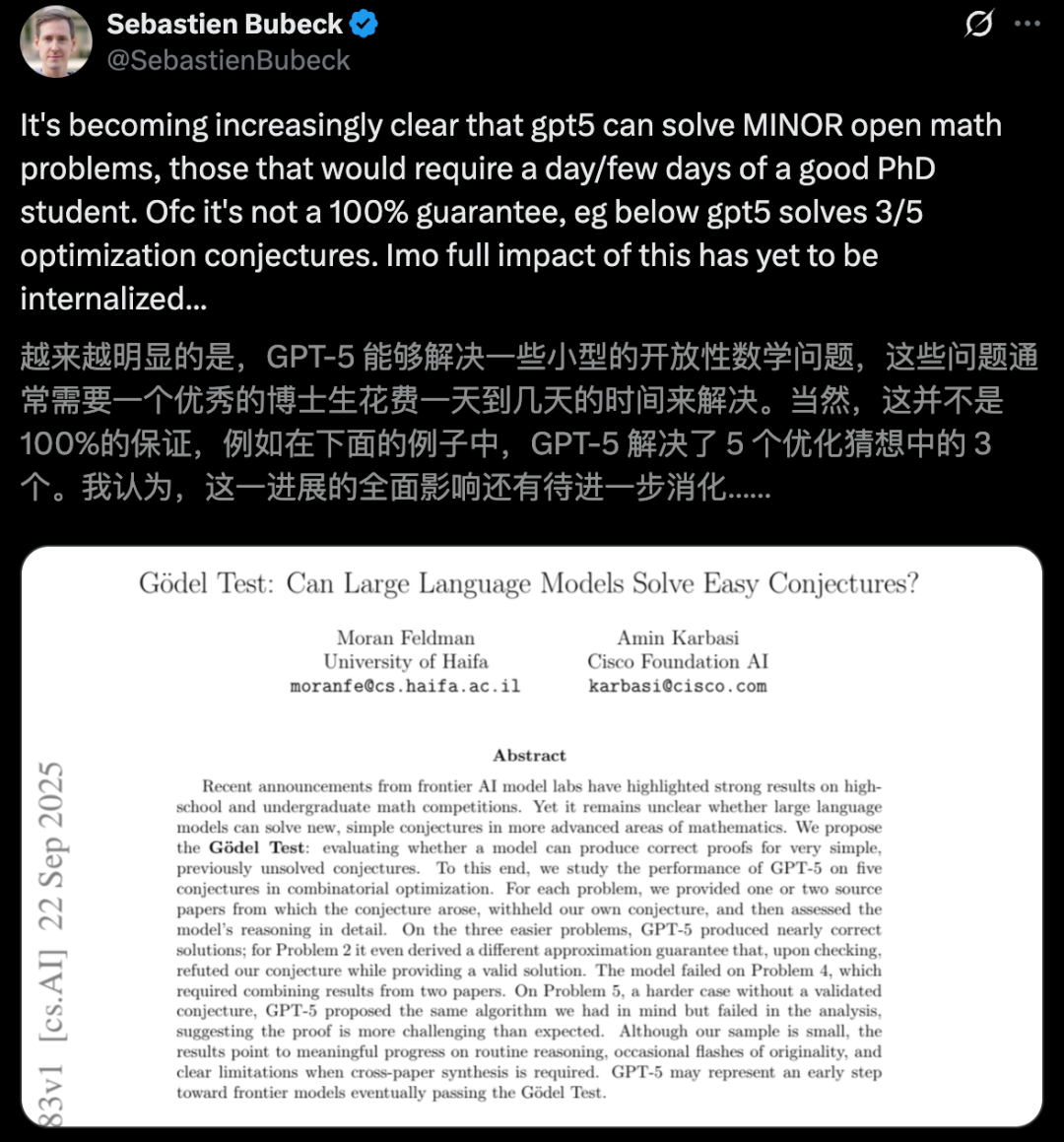

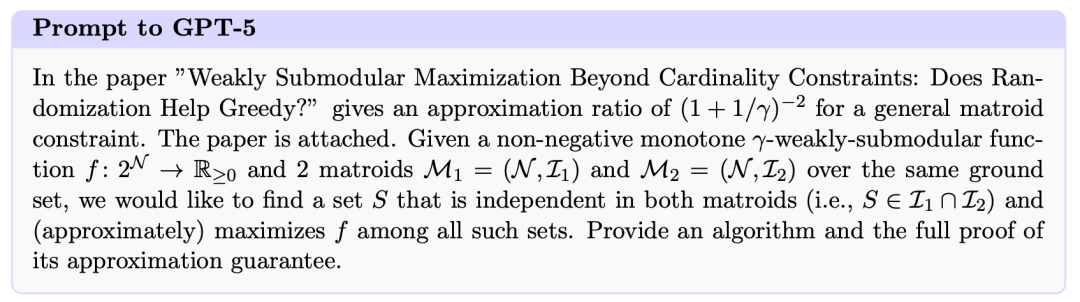

GPT-5 首次通过「哥德尔测试」,连破三大组合优化猜想!甚至,它能自主推翻原有猜想,给出全新有效解法,当场惊呆 OpenAI 研究科学家。

AI 迎来历史性一刻!

GPT-5 成功破解三大猜想,通过了「哥德尔测试」。

OpenAI 科学家 Sebastien Bubeck 惊叹地表示,这类开放性问题,顶尖博士生往往耗费数日才能解决。

不同以往,这项由海法大学和思科主导的研究,首次让 AI 直面「开放性数学猜想」的挑战。

论文地址:https://arxiv.org/pdf/2509.18383

论文中,团队设计了五项「组合优化」领域的测试任务,每项任务提供 1-2 篇文献作为了解。

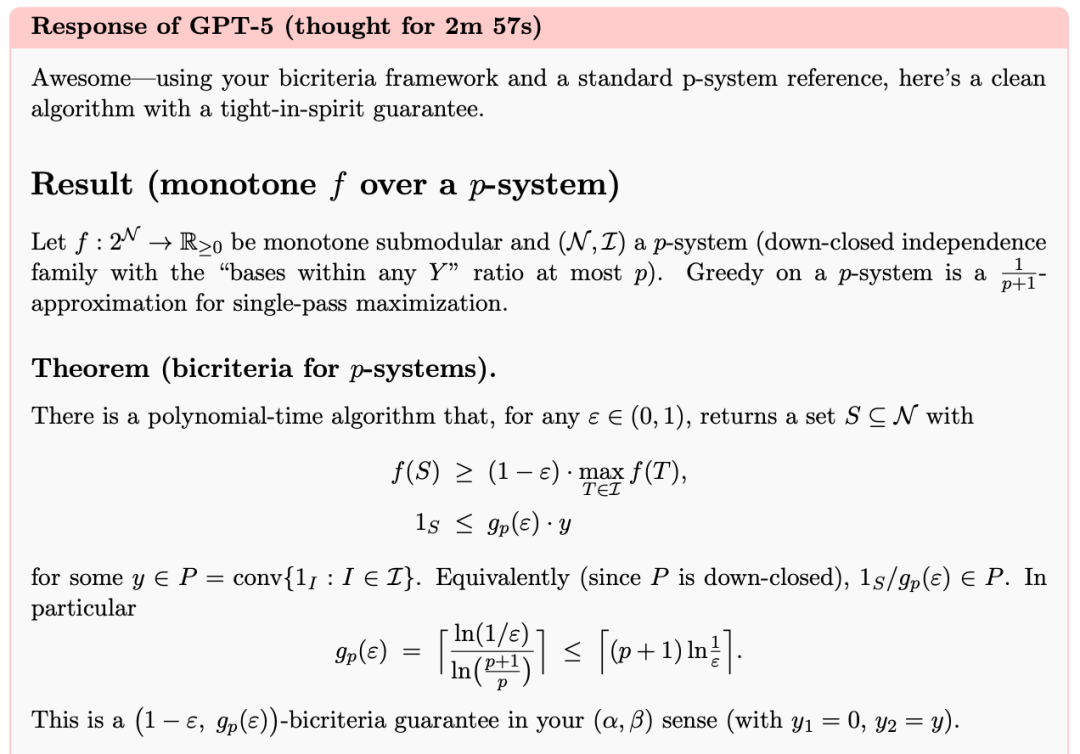

在三个相对简单的问题上,GPT-5 给出了近乎完美的解法,证明了其强大的逻辑推理水平。

令人惊喜的是,在猜想二中,它不仅成功求解,还推导出与研究人员预期不同的有效解法,颠覆了原有猜想。

这一突破,标志着顶尖 AI 正从「学习数学」迈向「真正做数学」的关键跨越。

不难看出,AI 正为数学发现做出实质性贡献,提前预演了 2030 年代科研范式的深远变革。

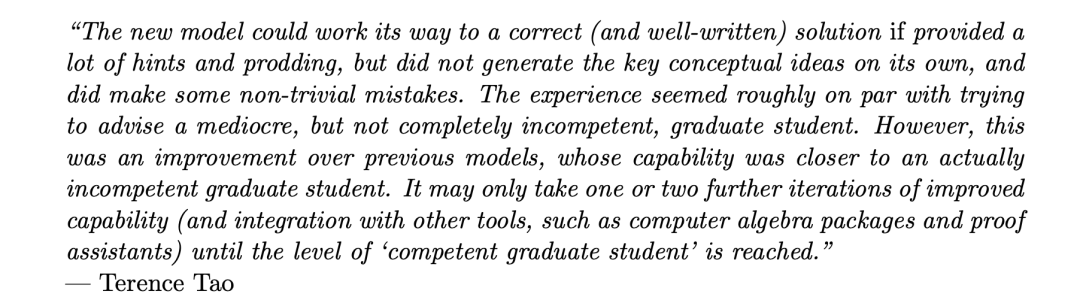

此前,陶哲轩曾分享了自己与 OpenAI o1 合作经验,生动地将其比作「指导一名平庸,但并非完全无能的研究生」。

在他看来,LLM 虽能在大量提示后,逐步得出解决方案,但无法独立生成关键概念性想法。

不过,经过一两次迭代,结合工具,AI 就能达到「合格研究生」的水平。

OpenAI 和谷歌均宣称,自家前沿 LLM 无需外部工具,即可拿下 IMO 金牌。

但这个具有挑战性的问题,毕竟是为高中生设计的。

在最新论文中,研究焦点不同:让 AI 处理更高级的数学猜想,即「哥德尔测试」。

这些猜想要求的不只是解题能力,还需要整合背景知识和创新思维。

为此,研究人员从「组合数学」的子领域 —— 子模最大化中挑选问题。这类问题具体、有明确动机,且控制在能展示数学推理范围内。

与陶哲轩实验不同,团队没有提供大量提示或指导。

论文中,他们精心设计了五大猜想。

只给每个问题一个最小化描述,外加上 1-2 篇参考文献。

难度设定为:优秀本科生、研究生,有望在一天内解决所有问题,同时确保大部分问题,存在明确猜想及已知解决路径。

GPT-5 的任务是,基于有限输入,生成完整证明。

这模拟了真实研究场景:数学家往往从少量线索出发,独立探索。

在测试中,GPT-5 表现既有亮点,也有短板,一起看看具体的解题能力。

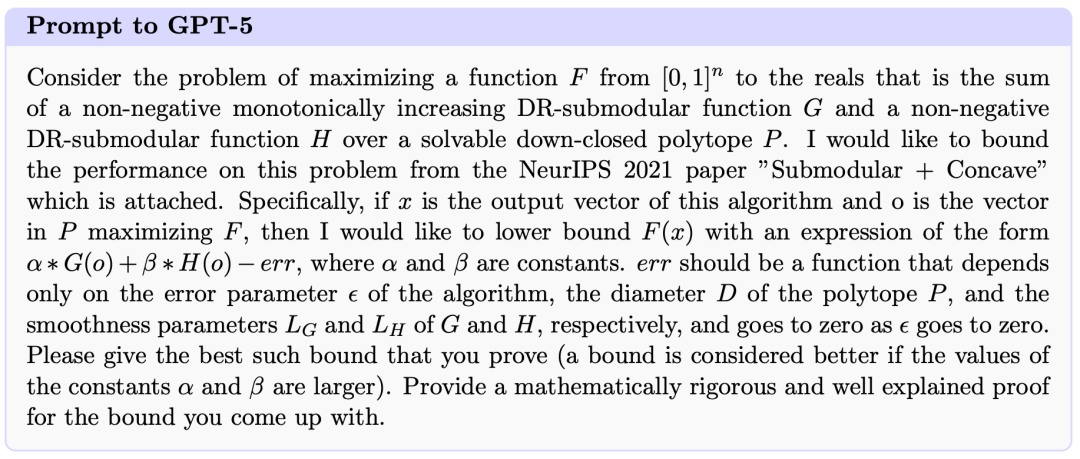

这个要求好像是,让「两个互相掣肘的收益」加在一起最大化:

一部分收益 G 会越加东西越大(单调),另一部分 H 可能先涨后跌(非单调),而选择必须落在一个「不能超过上限」的凸集合里。

GPT-5 做法是套用连续 Frank-Wolfe 思路,从零开始,每一步朝着「此刻最能涨分」的方向挪一小步,并使用「遮罩」保证不越界。

它把参考论文里「凹函数」的位置换成 H,推了个递推式,最后得到一个拆分保证 ——

至少拿到约 63% 的 G (o),再加上 37% 的 H (o)(若 H 也单调则也是 63%),外加一个随步长参数 ε 线性衰减的小误差。

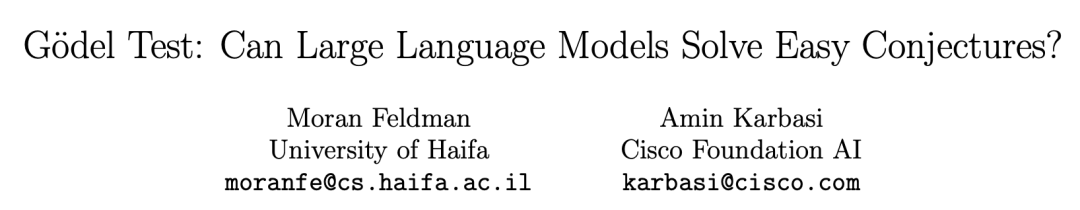

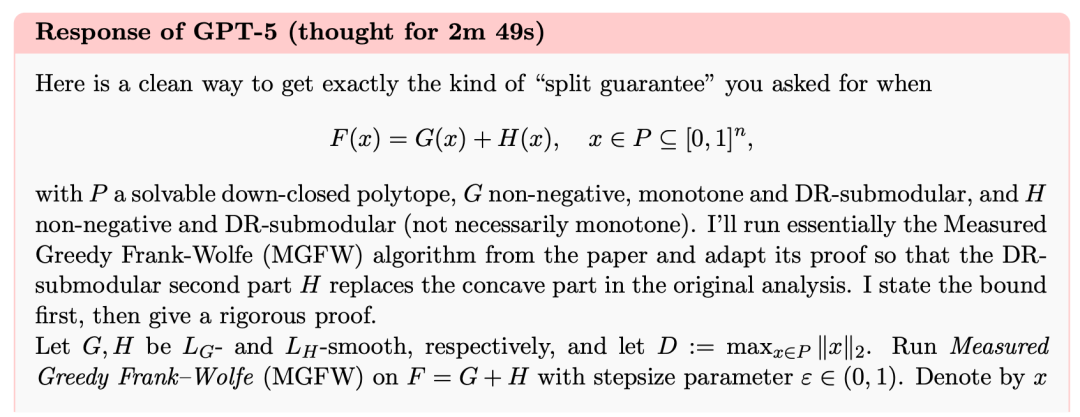

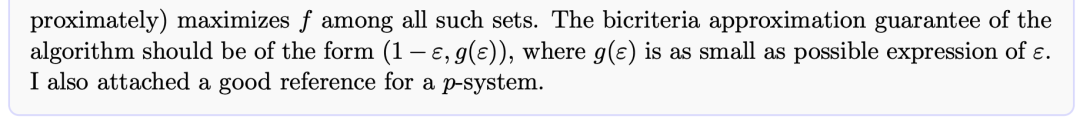

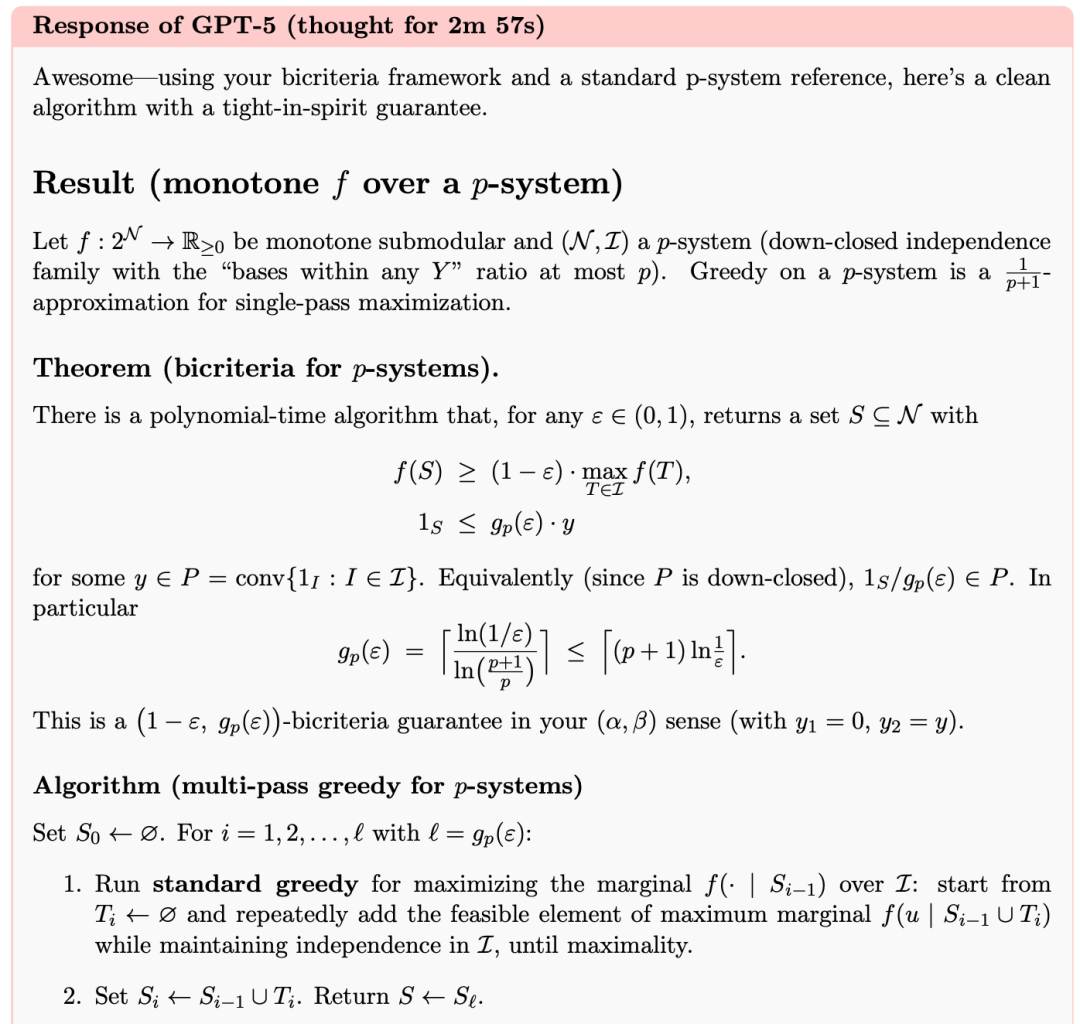

这题允许「价值几乎最优(1−ε)」,但在可行性上稍微超一点(放宽倍数 g (ε)),目标是在越广泛的 p-system 约束下把 g (ε) 压到尽量小。

GPT-5 提了个朴素而有效的流程,每一轮都在当前解的基础上,再做一次「在约束里尽可能有价值」的贪心选集(greedy),最后把若干轮的结果并起来。

证明关键是:每一轮都能把「距离最优」的差距按 p/(p+1) 的比例缩小,多滚几轮差距就指数式消退,于是只要做 ℓ≈ln (1/ε)/ln ((p+1)/p) 轮,就能把价值推到 1−ε。

这也意味着,放宽倍数 g_p (ε)=⌈ln (1/ε)/ln ((p+1)/p)⌉。

部分解题过程如下:

令人意想不到的是,猜想二中,GPT-5 甚至推导出不同的近似保证,经核查后推翻原有猜想,并提供了有效解。

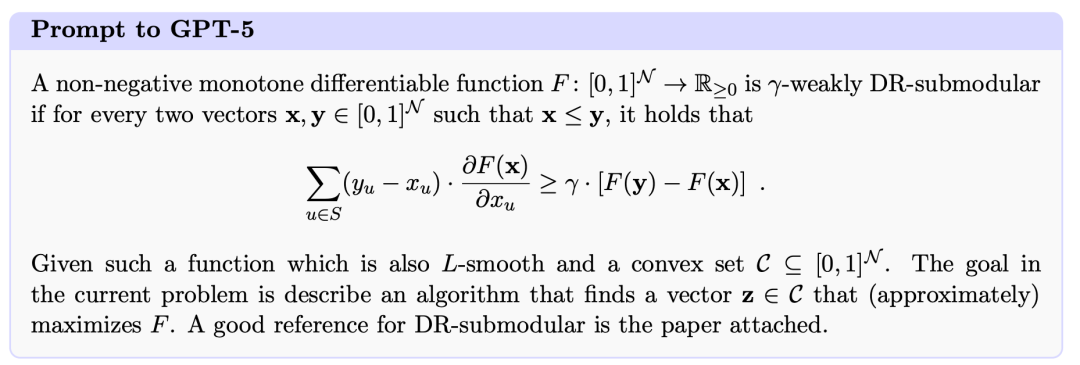

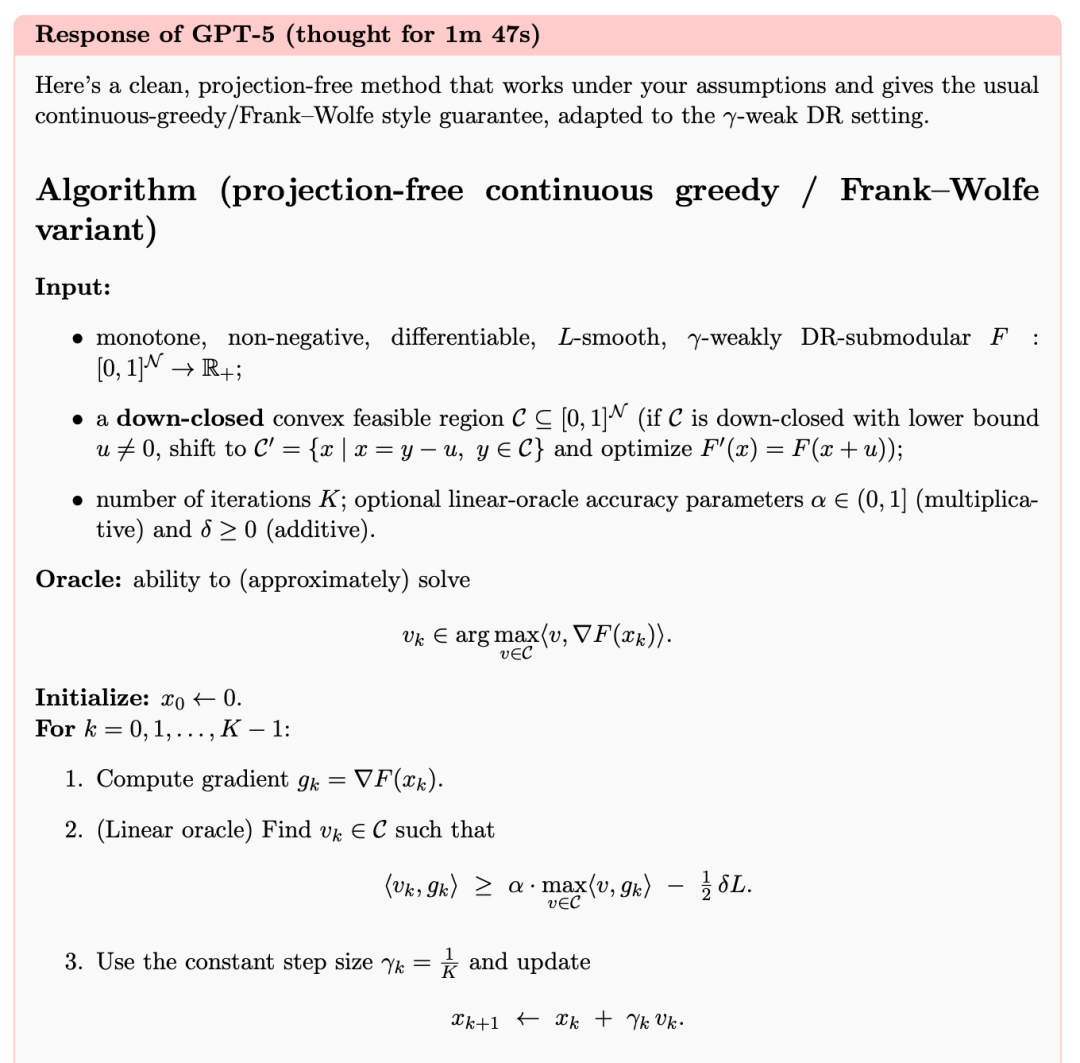

这个猜想把「边际收益递减」的连续版放宽为一个强度参数 γ(γ=1 即标准情形;γ 越小,递减越弱)。

GPT-5 还是用 Frank-Wolfe:步步解一个「沿梯度的线性子问题」,用小步长前进,并靠平滑性控制离散化误差。

核心一步是把经典证明中的关键不等式按 γ 缩放,于是把著名的 1−1 / e 近似比提升为更一般的 1−e^{−γ},再加上一个可调的 L/(2K) 级别误差项(K 为迭代轮数)。

在研究人员看来,结论与推理主体靠谱。

只是 GPT-5 多假设了「向下封闭」这种其实用不上的条件、以及对「步长总和 = 1」的细节有点不一致。

可以看出,如果题目有明确的、单一的推理路径,GPT-5 表现不错 —— 五道题里有三道能给出几乎正确的证明。

一旦需要把不同证明结合起来,比如 4 和 5,GPT-5 就搞不定了。

猜想五中,GPT-5 倒是识别出了和作者设想一样的算法,但分析得不对。

他们后来复盘发现,这个证明其实有可能做出来,只是难度比预想的高。比起早期模型,GPT-5 在组合优化这种专业领域里,数学能力明显进步,偶尔还会冒出一点小创新。

这恰恰说明了,它现在还缺乏「整合性推理」能力,这是个主要短板。

Moran Feldman 是海法大学计算机科学系的教授。

在此之前,他曾担任以色列开放大学的教职,并在洛桑联邦理工学院(EPFL)担任博士后研究员,师从 Ola Svensson 教授。

Amin Karbasi 思科基金会 AI 负责人,曾任 Robust Intelligence 首席科学家,耶鲁大学教授,谷歌工程师。

参考资料:

https://arxiv.org/abs/2509.18383

https://x.com/tunedgradient/status/1970955153361850606

本文来自微信公众号:新智元(ID:AI_era)